随着人工智能(AI)技术的不断进步,深度学习(Deep Learning) 识别和处理图像的能力不断提高,并已经大量应用于生活当中,并通过众多的手机应用迅速在民用领域中被大家所熟悉和接受。

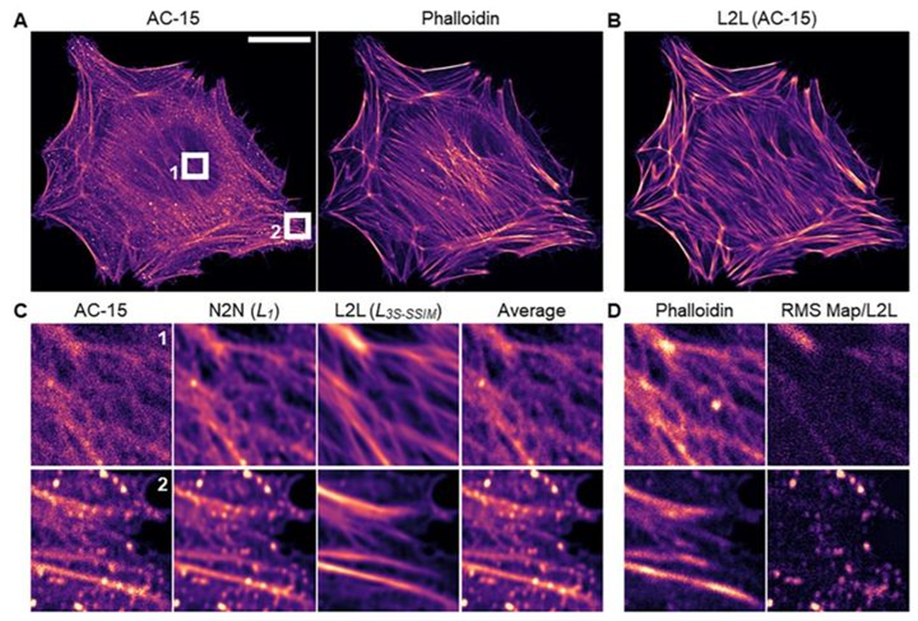

但显微图像的智能数据处理还处在一个初始阶段。学术领域,特别是生命科学研究的图像处理往往与民用方式有所区别。比如,在细胞荧光成像应用中,往往不存在直接可用的模型,因而需要有针对性的神经网络训练。其中,大量的前期训练是确保结果真实可信的重要手段。 在大多数显微图像处理中,深度学习的训练需要手工生成数据标签。这为深度学习的显微应用带来了较高的门槛。如何更快更便捷地制备带标签的训练数据集则成为了当下显微图像AI处理的关键技术之一。本文为大家介绍一篇具有代表性的论文:用双重染色(L2L)训练神经网络,在荧光显微镜下选择性地恢复细胞结构。 简单来说,就是针对相同的细胞结构,选取两种不同的染料作标记。互为数据和标签。从而在不用手工打标签的前提下实现了智能分辨结构的深度学习模型。 举下图为例:对固定了的HeLa细胞,用单克隆抗β-肌动蛋白抗体AC-15和phalloidin染色剂双重标记肌动蛋白丝。可以看到抗体AC-15的图像显示,细胞体中有很高的背景信号。即使把它做一个20帧的平均后,噪声虽然降低了,但背景信号仍然存在。与之对比,phalloidin则显示出较好的对比度。因此可以将AC-15的图像用作输入,phalloidin染色的图像被用作L2L训练的基准,成功获取到去除背景的肌动蛋白经构图像。在图中,作者还对比了Noise2Noise(N2N,详见原文)方法训练后的结果,进一步证明L2L的效果优势。

肌动蛋白图像的定性 L2L 和 N2N 结果。 (A) 用抗 β- 肌动蛋白抗体 AC-15 和一种 phalloidin 染色剂双重标记的固定 HeLa 细胞的共聚焦图像对。 (B) L2L 训练后 CNN 重建的 AC-15 图像, AC-15/ phalloidin 的图像作为训练输入/ 基准,使用 L3S-SSIM 损失函数。 (C) 两个 ROI (6 μm×6 μm) 的 AC-15 的原始图像和处理后的图像。从左到右:原始图像,分别使用 L1 和 L3S-SSIM 损失函数进行 N2N 和 L2L 训练后的恢复图像,以及 20 帧平均值。 (D) L2L 训练后网络生成的phalloidin 的对应图像和 AC-15 的原始图像和预测图像之间的 RMS 图。

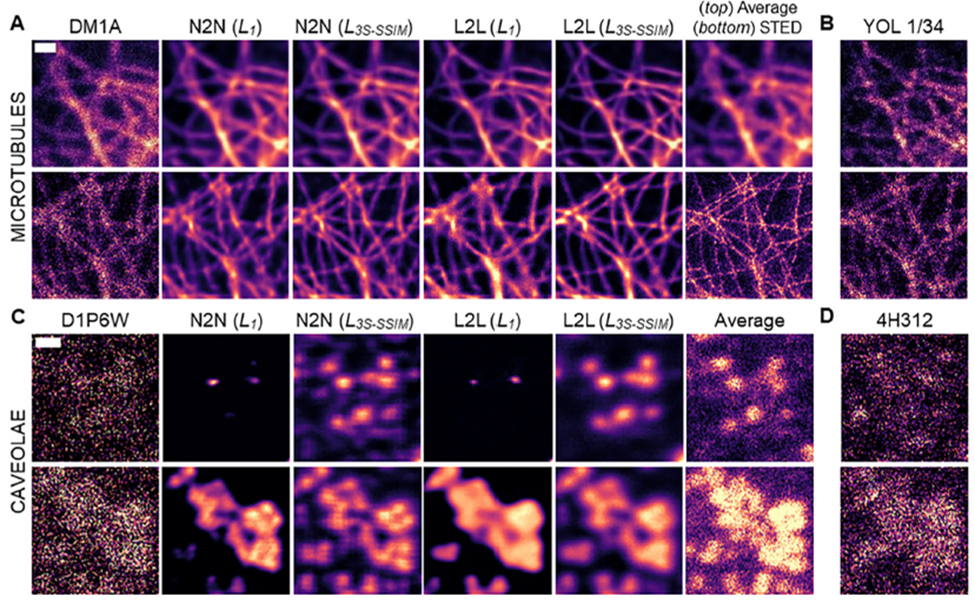

此外,作者还对比了另外三种不同细胞结构的图像数据:微管网络、小窝、和粘着斑,来演示这种标记训练方法。

参考文献:

Lisa Sophie Kölln et al. Label2label: training a neural network to selectively restore cellular structures in fluorescence microscopy, J Cell Sci, (2022) 135 (3).

收藏

文章导航